Khi DeepFake Biến "Lòng tin số" thành Rủi ro chiến lược

“Các nhà lãnh đạo doanh nghiệp phải nghĩ đến việc bảo vệ công ty của mình.” Đây không còn đơn thuần là một vấn đề an ninh mạng; nó là một Rủi ro Doanh nghiệp toàn diện.

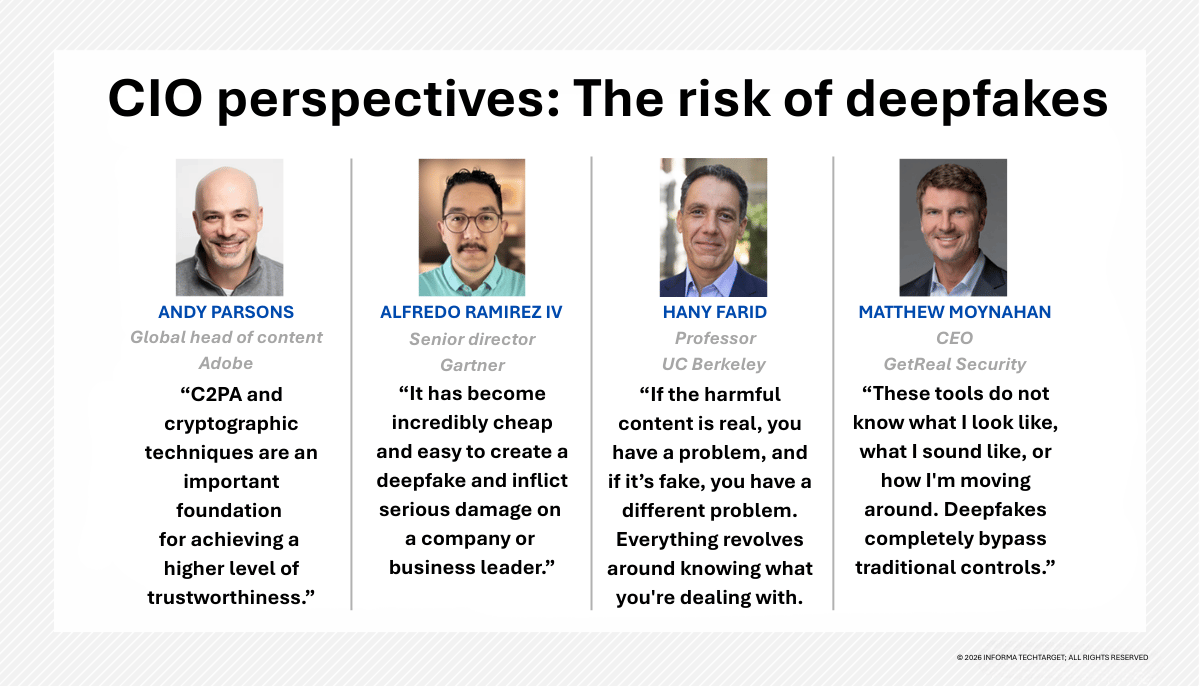

Trong phòng họp hội đồng quản trị năm 2026, Deepfake đã chính thức chuyển dịch từ một “sự tò mò về công nghệ” sang Rủi ro Doanh nghiệp số 1. Theo phân tích gần đây từ InformationWeek, chúng ta đang chứng kiến sự tiến hóa của Thỏa hiệp Giao tiếp Doanh nghiệp (BCC) — một “kẻ kế nhiệm” gây chết người hơn nhiều so với Thỏa hiệp Email Doanh nghiệp (BEC) truyền thống. Trong thời đại của BCC, những kẻ tấn công không chỉ giả mạo tin nhắn; chúng chiếm quyền kiểm soát sự hiện diện vật lý của bạn.

Như Andy Parsons (Adobe) cảnh báo: “Các nhà lãnh đạo doanh nghiệp phải nghĩ đến việc bảo vệ công ty của mình.” Đây không còn đơn thuần là một vấn đề an ninh mạng; nó là một Rủi ro Doanh nghiệp toàn diện.

Sự sụp đổ của “Lòng tin thị giác”

Deloitte ước tính rằng thiệt hại tài chính từ gian lận do AI tạo ra tại Hoa Kỳ có thể lên tới 40 tỷ đô la vào năm 2027, tăng từ mức 12,3 tỷ đô la vào năm 2023. Deepfake đang được vũ khí hóa trên mọi phương diện:

Thao túng thị trường: Giả mạo phát ngôn của lãnh đạo để làm biến động giá cổ phiếu.

Gian lận tuyển dụng: Sử dụng danh tính tổng hợp để xâm nhập vào tổ chức trong các cuộc phỏng vấn từ xa.

Phá hoại thương hiệu: Quấy rối các giám đốc điều hành hoặc làm tổn hại uy tín thông qua các hình ảnh nhạy cảm do AI tạo ra.

Trong thế giới ưu tiên làm việc từ xa hậu Covid, các cuộc gọi video đã trở thành chuẩn mực, nhưng nguồn gốc của chúng ngày càng không thể xác minh. Matthew Moynahan (CEO của GetReal Security) lưu ý: “Ngày càng có nhiều phương tiện truyền thông đến từ các nguồn và điểm xuất xứ không thể xác minh.”

Vụ trộm 25 triệu đô la tại Arup (2024): Một nhân viên tài chính đã chuyển tiền sau một cuộc họp video mà mọi “lãnh đạo cấp cao” trên màn hình đều là giả mạo do trí tuệ nhân tạo tạo ra.

Vụ vi phạm tại Qantas (2025): Các chuyên gia tin rằng việc sao chép giọng nói đã được sử dụng để lừa nhân viên tổng đài, dẫn đến việc 6 triệu thông tin đăng nhập của khách hàng bị xâm nhập.

Các CIO đang mắc kẹt trong một sự đánh đổi. Thắt chặt bảo mật (Giảm APCER) và bạn có nguy cơ từ chối nhầm người dùng hợp pháp (BPCER cao hơn), làm hỏng trải nghiệm người dùng. Ưu tiên một hành trình “không ma sát”, và bạn vô tình mở cửa hậu cho các cuộc tấn công Cấp độ 3 như mặt nạ 3D và deepfake độ phân giải cao.

Mục tiêu không còn là “sự cân bằng” nữa — mà là hiệu suất “Không-Không”. Bảo mật tuyệt đối với không ma sát cho người dùng. Trong cuộc chạy đua vũ trang AI này, các CIO cần dữ liệu thực tế, không phải những lời hứa quảng cáo. Một ví dụ điển hình về việc phá vỡ “Nghịch lý Bảo mật-UX” đã được Oz Forensics ghi nhận gần đây trong đợt thử nghiệm độc lập tại phòng lab BixeLab danh tiếng.

Họ đã thiết lập một Tiêu chuẩn Ngành mới bằng cách đạt được điểm số tuyệt đối trong các điều kiện Cấp độ 3:

0% APCER: 100% nỗ lực giả mạo tinh vi (mặt nạ 3D, video deepfake) đã bị vô hiệu hóa.

0% BPCER: 100% người dùng hợp pháp được nhận diện ngay lập tức mà không bị từ chối sai.

Kết luận Doanh nghiệp: Đạt được hiệu suất “Không-Không” ở mức thử nghiệm nghiêm ngặt nhất không chỉ là một chiến thắng về kỹ thuật. Nó mang lại ROI Kinh tế to lớn: Cắt giảm chi phí đánh giá thủ công, loại bỏ thiệt hại tài chính từ các cuộc tấn công BCC và bảo vệ tính toàn vẹn của Lòng tin số.

Deepfake không phải là rủi ro của “tương lai”; chúng là rủi ro của “sáng nay”. Khi các công cụ video AI trở nên phổ biến, Lòng tin số của bạn không thể được bảo vệ bởi các giải pháp “đủ dùng”. Nó phải được bảo vệ bởi các tiêu chuẩn tuyệt đối.

Câu hỏi dành cho bạn: “Khung danh tính hiện tại của bạn là một ‘cánh cửa thép’ chống lại Deepfake, hay vô tình là một ‘lối tắt’ cho những kẻ xâm nhập công nghệ cao tiến vào trung tâm tổ chức?”

Tổng hợp: CIO Vietnam

Nguồn tham khảo:

Deepfake như một rủi ro doanh nghiệp: InformationWeek

Xác nhận chính thức về thử nghiệm ISO/IEC 30107-3 PAD Level 3 (BixeLab) cho Oz Forensics: Xem tại đây